Umělá inteligence v komunikaci vědy. Tipy z panelové diskuze

Petr Cieslar, 11. března 2023

Přinášíme report plný tipů z panelové diskuze Umělá inteligence v komunikace vědy, která proběhla 7.3. v Kampusu Hybernská. Jsme moc rádi, že v auditoriu bylo plno a že s námi diskutoval technologický novinář Pavel Kasík, právní expertka Linda Kolaříková a kreativec zaměřený na popularizaci vědy Jakub Hardt.

AI komunikátory vědy nenahradí!

Ať už jde o novinařinu, pořádání eventů, přednášky, nebo obecně agendu komunikace vědy, podle Pavla Kasíka není úplně na místě přemýšlet nad AI nástroji tak, že budou primárně snižovat stavy pracovníků.

„Umělá inteligence nebude nahrazovat konkrétní role a profese, ale jistě bude nahrazovat některé části práce. Něco, co bych normálně dělal hodinu, budu mít za pět minut,“ vysvětluje Pavel Kasík.

Zároveň upozorňuje, že většina lidí umělou inteligenci ke zvýšení produktivity ještě nepoužívá.

Ti, kteří ji už využívají, tak mohou nabýt dojmu, že teď mají na monitoru „tajnou zbraň“, jež nikdo jiný nemá. Tato situace ale nevydrží dlouho, práce s umělou inteligencí se stane v horizontu pár let naprostým standardem

Vygenerované snímky k nerozeznání od reálných fotografií

Pavel v lednu tohoto roku v rámci mapování AI nástrojů a jejich vlivu na společnost spustil na Seznam Zprávách pro čtenáře test na rozpoznávání AI fotografií od snímků skutečně vyfocených fotografy.

„Našel jsem si 60 reálných snímků a k nim jsem pak nechal skrze textové prompty vygenerovat dalších 60 snímků,“ popisuje.

Výsledky? „Test si vyzkoušelo více než 100 000 čtenářů a průměrně lidé dosáhli 54% úspěšnosti. Myslím si, že je to důkaz toho, že už nemůžeme po lidech chtít, aby se učili rozpoznat falešnou fotku od pravé,“ hodnotí výsledky testu.

Podle Pavla by mohlo být řešením odklonit se od tzv. black-listu stránek a zdrojů, tedy zdrojů,kterým vůbec nevěřím, a cíleně si sepsat tzv. white-list zdrojů a stránek, kterým věřím. K ostatním zdrojům v digitální džungli pak přistupovat velmi kriticky, ať už se jedná o text, video či obrázek.

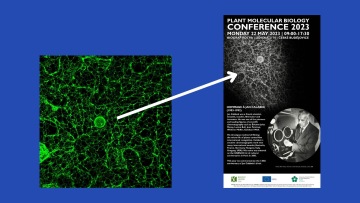

AI zvládne i mikroskopické snímky

Zkušenost s generováním snímku má i Jakub Hardt z Biologického centra AV ČR. „Dostal jsem za úkol připravit plakát na konferenci. Chtěl jsem využít mikroskopický snímek proteinu, ale pro vhodnou grafickou úpravu mi chyběla dostatečná velikost obrázku. V té době jsem si s AI začínal hrát, takže jsem se rozhodl, že nechám obrázek proteinu dogenerovat AI,“ vysvětluje Jakub.

Jakub tak z původního snímku proteinu, který je poměrně složité získat, nebo znovu nafotit, poněvadž se fotí např. elektronovým mikroskopem, vzal asi 40 % původníhu snímku, a zbytek nechal vygenerovat umělou inteligenci.

„Z vědců nikdo nepoznal, že se jedná o obrázek obohacený o vygenerovanou část. Kdybych využil dříve klasický postup úpravy snímku, znamenalo by to udělat si několik vrstev, ty vrstvy zkombinovat a byly by to hodiny a hodiny práce. Díky integrovanému AI nástroji ve Photoshopu jsem měl za chvíli hotovo,” popisuje Jakub Hardt techniku generování a zvýšení produktivity.

Jakuba sice po konferenci vědci za plakát pochválili, nicméně jak oni, tak Jakub od té doby vidí v AI kromě příležitosti i jistý druh nebezpečí.

Generování obrázků a autorské právo?

Na panelové diskuzi jsme v rámci ukázek promptů jeden stylizovali do vizuální podoby rodiny Simpsonů.

Díky AI nástrojům lze ale obrázky stylizovat do téměř jakéhokoliv (audio)vizuálního díla – Pán prstenů, Star Wars, Duna 2 – zkrátka cokoliv, co vás napadne.

„Jedná se o typicky problematické věci. Star Wars určitě podléhá autorským právům, případně někomu, kdo má na dané dílo licenci. Publikování takovýchto stylizovaných obrázků či videí na oficiálních stránkách či sítích instituce může znamenat porušení autorských či licenčních práv,” domýšlí důsledky generování a publikování stylizovaných obrázků Linda.

Podle Lindy je také důležité znát pravidla a licenci konkrétního nástroje, který ke generování obsahu používáme.

„Některé nástroje třeba vůbec neumožňují komercializaci, jiné nástroje mají minimum omezení a je v pohodě vygenerovaný obsah zpeněžit či prezentovat,” upozorňuje právní expertka na pravidla jednotlivých licencí rozmanitých AI nástrojů.

Textová náročnost i instantní feedback

Pokud se váš obor v rámci komunikace vědy zabývá spíše psaním a úpravou textů, tak kromě samotného zvýšení výkonnosti při psaní, lze AI využít např. při škálování textové náročnosti.

AI nástroje dokáží poměrně jednoduše vysvětlit libovolné cílové skupině složitou problematiku (např. vysvětlit teorii relativity dětem z mateřské školky, nebo objasnit proces klimatické změny seniorům, kteří přijdou na přednášku do městské knihovny).

Dalším tipem při práci s textem může být využívání tzv. simulování person. Jednoduše AI nástroji přikážeme, aby vystupoval za nějakou roli a podle toho jednal.

„Já nepoužívám AI na tvorbu textu článků, ale používám ji předtím, mezitím i potom na vylepšení. Takže třeba AI napíšu, ať se chová jako zvědavý čtenář, který vůbec nic neví o umělé inteligenci, ale chce se dozvědět co nejvíce. AI nástroji v roli nadšeného čtenáře řeknu, ať mi na text dá zpětnou vazbu. Takhle testuju svoje články a nechám si dávat takový instantní feedback třeba i v 11 v noci,” radí Pavel.

Často jsou pro Pavlovy články charakteristické hromady boxíků i grafů vysvětlujících různorodou problematiku.

Na navrhování možných boxíků si dokonce Pavel speciálně vytrénoval AI bota. Ten mu navrhuje, jak článek vylepšit a vyšperkovat přesně o tyto věci. „A taky mi rovnou řekne, kde bych ta data mohl sehnat, nebo jak by se to ještě hodilo doplnit. A to mi pomáhá, protože spousta z těch věcí by mě třeba nenapadla,” svěřuje se Pavel.

Prompt: British robot, medieval times style

V Biologickém centru AV ČR se s AI pracujete rovněž feedbackově. „AI skutečně dokáže vylepšit texty. U nás ji používáme hlavně k vyšperkování tiskových zpráv, které jsou v angličtině,” shrnuje Jakub.

Pokud jde o autorské právo k textům vygenerovaným AI, je to složité.

„Autorem může být v českém, ale i ve většině právních prostředí, jenom člověk, fyzická osoba. To znamená, že cokoliv, co vypadne z nějakého AI nástroje, tak to autorské dílo není a tím pádem to nemá právní ochranu. V Česku je jediná cesta, jak se dostat k autorskému právu u věcí vygenerovaných AI tak, že s výsledky ještě dále kreativně pracujete, přičemž byste navíc museli kreativní proces nějakým způsobem doložit,” radí Linda.

Deepfake videa s vědci

AI technologie umožňuje generovat i videa. Kromě své pozitivní stránky (např. vygenerování AI avatara, namlouvání článků či generování překladů videí do jiných jazyků) má vytváření videí i negativní efekt – tvorbu tzv. deepfaků (tedy videí s pozměněným obsahem, která jsou s různým záměrem šířena bez vědomí osoby vystupující ve videu).

Případ s deepfake videem řešili v Biologickém centru AV ČR. „K vygenerování sugestivního deepfaku, který lákal na produkty proti parazitům v lidském těle, použili naše starší video z YouTube, které jsme natáčeli, když byl vědec v zahraničí,” vysvětluje Jakub proces generování.

Zatímco videa, která produkuje Biologické centrum AV ČR, mají dosahy a shlédnutí v řádu tisíců a desetisíců, deepfake video dosáhlo v obou metrikách statisíců.

Deepfake se k Jakubovi dostal přímo od samotného vědce, a jako specialistu na sociální sítě čekalo Jakuba na základě prosby od právního oddělení martýrium v podobě sběru důkazů a také sisyfovský úkol v podobě snahy o zablokování videa na FB.

„Potřeboval jsem, aby Facebook, respektive Meta, video stáhl. Zároveň jsem dělal screenshoty a snažil se jít po stopách sdílení videa do různých skupin na Facebooku. Pokud budete něco na Facebooku nahlašovat a budete potřebovat okamžitou reakci, máte na výběr formulář s různými přednastavenými případy, proč chcete obsah zablokovat, nicméně dopracovat se k možnosti, která bude reálně fungovat, je poměrně obtížné,” vysvětluje Jakub.

Nakonec Jakuba napadlo odvolat se na jednu z možností v formuláři, konkrétně porušení autorských práv.

Jako důkaz uvedl ve formuláři odkaz na původní video na Youtube a Facebook nakonec video skutečně zablokoval. Minimálně mentální škoda, ale zůstala, a vytvořit další obdobný deepfake není vůbec těžké.

Případ svým pojetím připomíná deepfake reklamy např. na zázračné zbohatnutí s českými politiky i známými osobnostmi.

„Vždycky se najde nějaké procento adresátů, které se na podvody obecně chytne. AI to ale nějakým způsobem zesiluje. Pro mě jsou to vždycky vlastně takové pořád se opakující závody ve zbrojení, kdo je vždycky ten poslední, zda právo, nebo technologie,” vysvětluje Linda.

Podle Lindy domáhání se stažení videí u korporací typu Meta připomíná boj s větrnými mlýny, nicméně doporučuje celou případnou kauzu dokumentovat a předat policii.

„Právní nástroje máme, ale ideální je, když znáte pachatele. Přijít na policii nic nestojí, podat trestní oznámení také ne a úřady by se s tím už měly nějak vypořádat a řádně zformulovat. Motivace k vyšetření je ale mizivá, úřady i policie většinou samozřejmě ví, že toho pachatele nikdy nedoženou, takže to skončí odložením,” dodává Linda.

I tak ale Linda doporučuje mít vše zdokumentováno a připraveno k použití, kdyby náhodou policie pachatele vypatrála, nebo by se na vás obrátili novináři s prosbou o vysvětlení.

Kde panelisty sledovat?

Pavla Kasíka na jeho Xku (Twitteru), Lindu Kolaříkovou na jejím LinkedInu a Jakuba Hardta taktéž na jeho LinkedInu.